Załóżmy więc, że ![]() jest przestrzenią liniową nad

jest przestrzenią liniową nad ![]() .

.

Zwróćmy uwagę, że z uwagi na symetryczność, liniowość iloczynu skalarnego na 1. współrzędnej implikuje liniowość na 2. współrzędnej:

Zazwyczaj w przestrzeni ![]() istnieje wiele funkcji

istnieje wiele funkcji

![]() spełniających warunki definicji iloczynu

skalarnego. Poniżej podajemy kilka przykładów iloczynu skalarnego w

różnych przestrzeniach.

spełniających warunki definicji iloczynu

skalarnego. Poniżej podajemy kilka przykładów iloczynu skalarnego w

różnych przestrzeniach.

Przykłady.

1. Standardowy iloczyn skalarny w

![]() . Dla wektorów

. Dla wektorów

![\begin{displaymath}X=\left[\begin{array}{c}x_1 \vdots x_n\end{array}\right],...

...array}{c}y_1 \vdots y_n\end{array}\right]\in {\mathbb{R}}^n\end{displaymath}](img1314.png)

2. W przestrzeni wielomianów

![]() możemy zdefiniować iloczyn

skalarny wzorem

możemy zdefiniować iloczyn

skalarny wzorem

3. Rozważmy macierz

![]() . Określamy funkcję

2-argumentową

. Określamy funkcję

2-argumentową

![]() wzorem

wzorem

Funkcja ![]() spełnia warunki (2) i (2') definicji iloczynu

skalarnego (tzn. jest liniowa względem obu współrzędnych). Dla

przykładu sprawdzimy addytywność na 1. współrzędnej.

spełnia warunki (2) i (2') definicji iloczynu

skalarnego (tzn. jest liniowa względem obu współrzędnych). Dla

przykładu sprawdzimy addytywność na 1. współrzędnej.

Problem. Dla jakich macierzy symetrycznych ![]() funkcja

funkcja ![]() jest dodatnio określona ?

jest dodatnio określona ?

Problemem tym zajmiemy się później.

4. Niech ![]() będzie zbiorem ciągów

będzie zbiorem ciągów

![]() liczb rzeczywistych takich, że

liczb rzeczywistych takich, że

![]() . łatwo sprawdzić, że zbiór

ten jest podprzestrzenią przestrzeni liniowej

. łatwo sprawdzić, że zbiór

ten jest podprzestrzenią przestrzeni liniowej

![]() (pozostawiamy to jako ćwiczenie).

(pozostawiamy to jako ćwiczenie).

W przestrzeni ![]() określamy iloczyn skalarny wzorem

określamy iloczyn skalarny wzorem

5. Niech ![]() oznacza przestrzeń liniową ciągłych funkcji

oznacza przestrzeń liniową ciągłych funkcji

![]() (

(![]() ). Działania w tej przestrzeni

liniowej określamy podobnie, jak w przestrzeni

). Działania w tej przestrzeni

liniowej określamy podobnie, jak w przestrzeni

![]() funkcji

ciągłych na

funkcji

ciągłych na ![]() .

.

W przestrzeni ![]() definiujemy iloczyn skalarny wzorem

definiujemy iloczyn skalarny wzorem

Przestrzeń euklidesową

![]() ze

standardowym iloczynem skalarnym oznaczamy symbolem

ze

standardowym iloczynem skalarnym oznaczamy symbolem ![]() .

.

Od tej pory w tym rozdziale zakładamy, że ![]() jest przestrzenią

euklidesową z iloczynem skalarnym

jest przestrzenią

euklidesową z iloczynem skalarnym

![]() . Podobnie jak w przypadku przestrzeni

. Podobnie jak w przypadku przestrzeni

![]() ze standardowym iloczynem skalarnym przyjmujemy następującą

definicję.

ze standardowym iloczynem skalarnym przyjmujemy następującą

definicję.

Następująca uwaga zawiera podstawowe własności iloczynu skalarnego.

1) łatwo sprawdzić (1), gdy ![]() są liniowo zależne (wówczas w

(1) mamy nawet

są liniowo zależne (wówczas w

(1) mamy nawet ![]() ). Załóżmy więc, że

). Załóżmy więc, że ![]() są liniowo

niezależne. Rozważmy funkcję

są liniowo

niezależne. Rozważmy funkcję

![]() zdefiniowaną

wzorem

zdefiniowaną

wzorem

2) Korzystając z (1) dostajemy

3) wynika z (2).

W przestrzeni euklidesowej definiujemy odległość ![]() między

wektorami

między

wektorami ![]() wzorem

wzorem

Na mocy nierówności Schwarza, dla wszystkich niezerowych wektorów ![]() mamy

mamy

Jak wspomnieliśmy na wstępie tego rozdziału, iloczyn skalarny można zdefiniować również w zespolonych przestrzeniach liniowych. Musimy wówczas jednak nieco zmodyfikować definicję 10.1.

Standardowy iloczyn skalarny

![]() w zespolonej przestrzeni liniowej

w zespolonej przestrzeni liniowej

![]() definiujemy

wzorem

definiujemy

wzorem

![\begin{displaymath}\langle Z,Z'\rangle=\sum_{i=1}^n z_i\overline{z_i}',\mbox{ gd...

...y}{c}z'_1 \vdots\\

z'_n\end{array}\right]\in {\mathbb{C}}^n.\end{displaymath}](img1362.png)

łatwo sprawdzić, że standardowy iloczyn skalarny w

![]() spełnia

warunki definicji 10.4. Zespoloną przestrzeń liniową

spełnia

warunki definicji 10.4. Zespoloną przestrzeń liniową

![]() z iloczynem skalarnym

z iloczynem skalarnym

![]() nazywamy przestrzenią unitarną.

nazywamy przestrzenią unitarną.

Można udowodnić, że uwaga 10.3 jest słuszna również dla zespolonego iloczynu skalarnego (ćwiczenie). Większość rozumowań dotyczących rzeczywistego iloczynu skalarnego przenosi się łatwo na iloczyn zespolony. (Wyjątkiem jest tu pojęcie kąta między wektorami, którego nie definiujemy w przestrzeni unitarnej).

W dalszym ciągu będziemy zajmować się przestrzenią euklidesową

![]() . Podobnie jak w przypadku przestrzeni

. Podobnie jak w przypadku przestrzeni ![]() przyjmujemy

następującą definicję.

przyjmujemy

następującą definicję.

2) Sprawdzamy, że zbiór ![]() jest zamknięty ze względu na

działania przestrzeni liniowej. Np. sprawdzimy zamkniętość

względem dodawania. Załóżmy, że

jest zamknięty ze względu na

działania przestrzeni liniowej. Np. sprawdzimy zamkniętość

względem dodawania. Załóżmy, że

![]() . Wówczas

również

. Wówczas

również

![]() , bo dla dowolnego

, bo dla dowolnego ![]() mamy

mamy

Przykładem bazy ortonormalnej w ![]() jest baza standardowa

jest baza standardowa ![]() .

.

Załóżmy, że ![]() jest niezerowy, niech

jest niezerowy, niech

![]() . Wówczas wektor

. Wówczas wektor ![]() jest już unormowany. Dlatego,

mając bazę ortogonalną przestrzeni

jest już unormowany. Dlatego,

mając bazę ortogonalną przestrzeni ![]() łatwo otrzymać bazę

ortonormalną, odpowiednio wydłużając lub skracając wektory

bazowe.

łatwo otrzymać bazę

ortonormalną, odpowiednio wydłużając lub skracając wektory

bazowe.

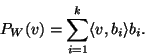

Zastosowania.

1. Załóżmy, że

![]() jest bazą ortonormalną

przestrzeni

jest bazą ortonormalną

przestrzeni ![]() . Następna uwaga pokazuje, jak łatwo znaleźć

współrzędne

. Następna uwaga pokazuje, jak łatwo znaleźć

współrzędne

![]() wektora

wektora ![]() w bazie

w bazie ![]() .

.

![\begin{displaymath}[v]_{{\cal B}}=\left[\begin{array}{c}\langle v,b_1\rangle \vdots\\

\langle v,b_n\rangle \end{array}\right].\end{displaymath}](img1401.png)

Załóżmy teraz, że

![]() jest liniowe. Wektory

jest liniowe. Wektory

![]() tworzą kolejne kolumny macierzy

tworzą kolejne kolumny macierzy

![]() . Współrzędne wektora

. Współrzędne wektora

![]() są postaci

są postaci

![]() . Dlatego

. Dlatego

![]() .

.

2.

Załóżmy, że ![]() jest podprzestrzenią

przestrzeni

jest podprzestrzenią

przestrzeni ![]() oraz

oraz

![]() jest bazą ortonormalną

przestrzeni

jest bazą ortonormalną

przestrzeni ![]() . Używając tej bazy możemy łatwo zdefiniować rzut

prostopadły

. Używając tej bazy możemy łatwo zdefiniować rzut

prostopadły

![]() przestrzeni

przestrzeni ![]() na podprzestrzeń

na podprzestrzeń ![]() wzorem

wzorem

Następująca uwaga uzasadnia, że w istocie tak określone

przekształcenie ![]() możemy uważać za rzut prostopadły na

możemy uważać za rzut prostopadły na ![]() .

.

2) Na mocy uwagi 10.8 (zastosowanej do przestrzeni ![]() z bazą

ortonormalną

z bazą

ortonormalną ![]() ),

),

![]() .

.

3) Po pierwsze sprawdzimy, że

Z drugiej strony

Pozostaje pokazać, że wektor ![]() jest jedynym wektorem

podprzestrzeni

jest jedynym wektorem

podprzestrzeni ![]() spełniającym

spełniającym ![]() . W tym celu przypuśćmy, że

. W tym celu przypuśćmy, że

![]() i

i ![]() . Pokażemy, że wówczas

. Pokażemy, że wówczas ![]() .

.

Skoro ![]() , to tym bardziej

, to tym bardziej ![]() dla

dla

![]() . Dlatego

. Dlatego

![]() , czyli

, czyli

![]() .

.

Na mocy uwagi 10.8 (podobnie jak w (2)),

Przykład.

Niech

![$u=\frac{1}{\sqrt{3}}\left[\begin{array}{c}1\\

1 1\end{array}\right], v=\frac...

...eft[\begin{array}{c}0\\

1 -1\end{array}\right],w=u\times v\in {\mathbb{R}}^3$](img1435.png) . Niech

. Niech ![]() będzie płaszczyzną generowaną przez

będzie płaszczyzną generowaną przez ![]() . Wówczas

. Wówczas

![]() jest bazą ortonormalną przestrzeni

jest bazą ortonormalną przestrzeni

![]() , zaś

, zaś

![]() bazą

ortonormalną podprzestrzeni

bazą

ortonormalną podprzestrzeni ![]() .

.

Rzut prostopadły wektora

![]() na płaszczyznę

na płaszczyznę ![]() wyraża

się wzorem

wyraża

się wzorem

Ponadto zgodnie z uwagą 10.8 łatwo znaleźć współrzędne wektora

![]() w bazie

w bazie ![]() :

:

![\begin{displaymath}[X]_{{\cal B}}=\left[\begin{array}{c}\langle X,u\rangle \langle

X,v\rangle \langle X,w\rangle\end{array}\right].\end{displaymath}](img1445.png)